Robot sociali & cyborg: la nuova frontiera

I robot sono un immenso specchio in cui da qualche tempo l’umanità intera ama riflettersi e contemplarsi. In passato si trattava principalmente di letteratura e cinematografia science-fiction, oggi invece ci confrontiamo con sistemi auto-organizzativi concreti che cominciano a entrare da protagonisti nella nostra vita quotidiana. In ogni caso, è una straordinaria opportunità di auto-conoscenza.

Massimo Morelli

Siamo abituati a pensare all’AI come la vera frontiera contemporanea del sapere e della tecnologia, e naturalmente c’è del vero, anche se in realtà è possibile che il confine non risieda tanto nello sviluppo dei sistemi auto-organizzativi ‘disincarnati’ (disembodied), quanto in quello dei sistemi ‘incarnati’ (embodied) come appunto i robot sociali e i cyborg. È proprio la presenza del corpo a spostare il confine un po’ più in là anche perché, secondo il ‘paradosso di Moravec’, contrariamente a quanto comunemente si pensa, nel campo dell’intelligenza artificiale e della robotica il linguaggio e il pensiero logico astratto richiedono meno risorse computazionali delle capacità percettive e senso-motorie.

Insomma, per un sistema artificiale sembra più facile pensare e parlare piuttosto che percepire, muoversi e orientarsi nello spazio fisico.

Cratere di Orvieto

Chi ha paura dei robot sociali?

C’è anche un’altra questione: i robot sembrano far più paura dell’Ai, che proprio perché disincarnata (disembodied) è meno visibile e quindi apparentemente meno minacciosa. Eppure, come spiega bene Max Tegmark nel suo Vita 3.0 [Max Tegmark, Vita 3.0, Raffaello Cortina Editore, Milano, 2018, pp.64-68], le cose stanno esattamente all’opposto. I robot hanno un corpo, ma proprio questo tende a limitare il loro potenziale distruttivo a livello locale e a renderli facile bersaglio di eventuali azioni correttive. L’AI, invece, è disincarnata e de-localizzata in complesse reti digitali: per combinare guai a livello globale le basta una connessione internet, ed è molto più difficile da disinnescare. Thomas Arnold, uno studioso di etica tecnologica alla Tufts University del Massachusetts, che vanta anche un dottorato in studi religiosi ad Harvard, sostiene che in quanto monoteisti noi occidentali abbiamo maggior facilità a rappresentarci le macchine super-intelligenti come sistemi singoli e possibilmente dotati di caratteristiche antropomorfiche (come i robot), mentre siamo concettualmente disarmati rispetto ai sistemi intelligenti molteplici e distribuiti che ricordano molto di più il pantheon politeista degli antichi greci; per questo tendiamo ad aver più paura di un lucente robot meccanico piuttosto che di un’impalpabile rete elettronica. Peccato che proprio in questo risieda la nostra più grande vulnerabilità: non dovrebbero essere i robot a spaventarci, bensì la più sfuggente e capricciosa intelligenza artificiale distribuita.

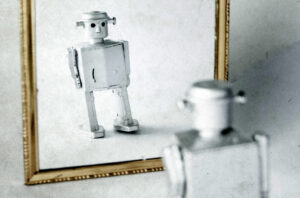

Specchio specchio delle mie brame

Robot allo specchio

È innegabile che oggi la robotica, e soprattutto la robotica sociale, abbia assunto un ruolo di straordinaria centralità nei programmi di sviluppo tecnologico e negli scenari più o meno futuribili prefigurati dai media contemporanei.

Ci sono molte buone ragioni perché sia così, la prima delle quali è la funzione di rispecchiamento collettivo svolta dai robot umanoidi e androidi. Se vale il principio della conoscenza attraverso il ‘reverse engineering’, secondo il quale si conosce veramente qualcosa solo se si è in grado di ri-farla, la robotica sociale è uno straordinario strumento di auto-conoscenza a disposizione degli esseri umani. Realizzando sistemi auto-organizzativi a nostra immagine e somiglianza, approfondiamo la conoscenza di noi stessi, comprendiamo meglio chi siamo e sino a che punto possiamo spingerci. È così da quando l’homo si è auto-definito ‘tecnologicus’, e quindi sin dai tempi del guerriero umanoide di Leonardo, degli automi di De Vaucanson o del programma meccanicistico dell’Homme Machine di La Mettrie.

Oggi come allora, i robot sono un immenso specchio in cui l’umanità ama riflettersi e contemplarsi.

Ripensare la concezione puritano-borghese del lavoro

Karl Marx

Alla social robotics sono anche legate molte prospettive di ridefinizione dei processi lavorativi e miglioramento della qualità della vita, soprattutto per le applicazioni in ambito educativo, medico e di assistenza sociale, ma bisognerebbe anche citare il settore più ‘finanziato’ di tutti, ovvero quello militare che punta alla realizzazione di robot di ausilio al combattimento sempre più sofisticati.

Grazie a queste nuove tecnologie si prospetta una vera e propria rivoluzione socio-economica. Il sistema capitalistico si è sempre attivato per sostituire i lavoratori in carne e ossa, capaci di coordinazione sociale – e quindi di mettere in atto potenziali strategie oppositive come i sabotaggi, gli scioperi, le autogestioni eccetera – con macchine e sistemi di automazione privi di qualsivoglia facoltà autonoma di interlocuzione. Anche lo sviluppo dell’intelligenza artificiale e della robotica va in questa direzione, e tuttavia in un certo senso si è spinto troppo oltre, sino a prefigurare la creazione di esseri dotati di straordinarie facoltà cognitive ma anche, e qui casca l’asino, di nuove e imprevedibili facoltà di interazione sociale. Come reagirà il Capitale di fronte all’introduzione su larga scala di sistemi automatici efficientissimi che però hanno una notevole capacità di coordinazione sociale e sono quindi potenzialmente molto più pericolosi? Come sappiamo, molti protagonisti dello sviluppo scientifico dell’AI hanno alzato la mano denunciando i rischi legati a una possibile ribellione o ‘presa di potere’ da parte di questi sistemi auto-organizzativi dotati di autonomia deliberativa. Ma, e di questo si parla troppo poco, a rischiare di più è proprio il sistema capitalistico che ha generato un modello di accumulazione fondato sullo sviluppo dell’automazione industriale.

Vedremo, ma intanto appare evidente che in un’ipotetico mondo a venire in cui siano stati risolti i problemi dell’approvvigionamento energetico (fusione, energia solare, bio-energie?) e il grosso delle funzioni necessarie alla soddisfazione dei bisogni primari sia stato demandato alle macchine, il concetto ‘borghese’ del lavoro come misura fondamentale della dignità umana andrà completamente ripensato. Già Bertrand Russell nel suo Elogio dell’Ozio (In Praise of Idleness, 1935. Tr. it. Longanesi, Milano, 2005) sosteneva che spostare carichi pesanti avanti e indietro sulla superficie della Terra non ha nulla a che vedere con le finalità ultime dell’esistenza umana.

Robot e filosofia della mente

Inoltre, la robotica sociale è praticamente il terreno di coltura, la dimensione sperimentale privilegiata della filosofia della mente, la quale, a sua volta, vive un momento di straordinaria centralità culturale proprio in quanto si trova al crocevia dei più importanti saperi contemporanei: fisica, neuroscienze, psicologia cognitiva, linguistica, etologia, antropologia, eccetera.

Attraverso la robotica sociale la filosofia della mente è in grado di indagare questioni fondamentali come la natura della coscienza e dell’intelligenza, il ruolo dell’empatia, della comunicazione non verbale e soprattutto del corpo in tutte le interazioni umane. Per non parlare della possibilità di studiare ‘dal vivo’ molti problemi etici che altrimenti resterebbero troppo teorici, astratti. Se i filosofi sono coloro che si preoccupano di sviluppare e migliorare continuamente la nostra ‘visione del mondo’, è chiaro che i robot in questa visione devono entrarci dalla porta principale. Benissimo, ma dove si trova esattamente questa porta?

Cyborg e eternità

Cyborg

Altrettanta importanza rivestono le tecnologie cyborg, laddove non si punta a creare robot sociali autonomi ma a potenziare le facoltà degli umani ibridandoli con sistemi tecnologici migliorativi. Secondo il capo degli ingegneri di Google, Ray Kurzweil, in un futuro molto prossimo utilizzeremo tecnologie impiantabili, come nanobot nel sangue o interfacce cervello-computer, che ci permetteranno di amplificare le nostre capacità cognitive e fisiche. All’orizzonte si profila anche la possibilità di superare la morte biologica trasferendo i contenuti della coscienza umana su supporti digitali.

Il mondo dei fumetti Marvel con i suoi pittoreschi protagonisti dotati di superpoteri sembra destinato a diventare realtà prima di quanto si creda. Ma anche qui naturalmente si aprono questioni spinosissime: chi gestirà queste super-tecnologie e a favore di chi? Come si concilieranno tali straordinarie prerogative con i limiti fisico-biologici del nostro mondo a risorse finite? Non sono interrogativi da poco.

Perché vogliamo che i robot assomiglino agli esseri umani?

Alzi la mano chi pensa che l’essere umano sia una creatura perfetta, non passibile di ulteriori miglioramenti. Io sicuramente non lo penso, e credo che la gran parte delle persone dotate di buon senso e onestà intellettuale condivida la mia opinione. Ma se è così, se l’uomo appare lungi dall’essere perfetto, come mai moltissime piattaforme di sviluppo robotico si concentrano su schemi progettuali umanoidi (struttura simile a quella umana) o androidi (idealmente indistinguibili dagli esseri umani)? Perché siamo così ossessionati dall’idea di generare artificialmente una creatura che ci assomiglia? Perché non cerchiamo di dar vita a un essere diverso e migliore di noi? È l’interrogativo che si è posta anche Mary Shelley immaginando la struggente vicenda esistenziale del suo Frankenstein…

Gli spiriti pratici hanno in canna una risposta sensata e credibile: progettiamo delle macchine simili all’uomo perché essendo le nostre infrastrutture sul pianeta Terra organizzate per favorire la sopravvivenza e il benessere degli esseri umani, se le machine devono agire e rendersi utili sul medesimo pianeta è preferibile che assomiglino agli umani per sfruttare al meglio le infrastrutture esistenti.

Andy Meltzoff

Tutto chiaro e condivisibile, tuttavia sono convinto che esista una risposta più profonda e vera di questa. Credo che il motivo fondamentale risieda nel fatto che noi esseri umani siamo creature mimetiche, che molto prima di essere creativi, innovatori, siamo dei portentosi e sistematici imitatori. È un aspetto confermato dalle ricerche del celebre psicologo infantile Andy Meltzoff, secondo il quale noi uomini siamo biologicamente predisposti all’imitazione sin da bambini, quando imitiamo i gesti, le espressioni facciali e le vocalizzazioni degli adulti.

Tutta la nostra enfasi sull’innovazione deriva dal fatto che per noi, in un certo senso, essa è contro-natura in quanto siamo biologicamente predisposti all’esatto opposto, alla mimesi. Oggi sappiamo, ad esempio, che molte innovazioni si verificano al termine di una lunga fase meramente imitativa: si pensi allo sviluppo tecnologico del Giappone, che dopo essersi dedicato per decenni all’imitazione industriale sistematica, oggi detiene il maggior numero di brevetti d’invenzione al mondo. Dal nostro istinto mimetico derivano sia il bene che il male della natura umana: da una parte l’empatia, che è il fondamento del nostro essere morali e compassionevoli verso gli altri, dall’altra il conflitto perpetuo, derivante dal fatto che, imitandoci a vicenda, finiamo per desiderare le stesse cose ed entriamo in conflitto per ottenerle a spese degli altri.

Ecco perché facciamo sforzi osceni allo scopo di generare creature digitali che ci assomigliano: perché è nella nostra natura di inveterati imitatori, perché non possiamo fare a meno di imitare addirittura noi stessi.

I sistemi digitali che oggi ci destano tanta meraviglia – machine learning, AI, LLM, robot ecc. – hanno ereditato da noi umani la caratteristica distintiva di essere profondamente imitativi: Essi imitano i nostri processi di produzione (si veda al proposito il bel saggio di Matteo Pasquinelli, The Eye of the Master), le nostre capacità di calcolo, il nostro linguaggio, il nostro pensiero, le nostre facoltà fisiche (robot) e addirittura le nostre espressioni artistiche (qui forse con minor successo). È un circolo vizioso mimetico: noi imitiamo noi stessi creando delle macchine che ci assomigliano, e queste ci imitano riproducendo artificialmente le nostre prerogative. Diciamo meglio: noi uomini imitiamo appassionatamente noi stessi attraverso le nostre creature digitali, i nostri robot.

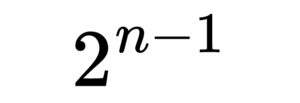

Il paradosso di Moravec

The Moth

Dalla fine degli anni ’40, allorché furono sviluppati i primi robot cibernetici come The Moth (triciclo con fotocellula che si muoveva autonomamente nell’ambiente lasciando una scia luminosa) o The Cybernetic Turtle (una ‘tartaruga cibernetica’ che da molti è considerata la progenitrice dei robot domestici) sino ai robot umanoidi o androidi contemporanei è stata fatta moltissima strada. Alcuni modelli, come i celebri Nao e Pepper hanno persino raggiunto un certo livello di diffusione, naturalmente non presso un pubblico retail ma di addetti ai lavori.

Tuttavia gli ostacoli tecnologici allo sviluppo dei robot sociali sono molteplici e complessi. Qui mi limito a citare alcuni dei più evidenti, il primo dei quali è certamente il già citato paradosso di Moravec, secondo il quale nel campo dell’intelligenza artificiale e della robotica il linguaggio e il pensiero logico astratto richiedono molte meno risorse computazionali di quante ne richiedano le capacità percettive e sensomotorie. Per capire meglio, ecco alcuni dati citati da Yann LeCun:

– il linguaggio ha una larghezza di banda ridotta: meno di 12 byte/secondo. Una persona può leggere 270 parole/minuto, o 4,5 parole/secondo, ovvero 12 byte/s (assumendo 2 byte per token e 0,75 parole per token). Un LLM moderno viene generalmente addestrato con 1×10^13 token a due byte, ovvero 2×10^13 byte. Per fare lo stesso, una persona avrebbe bisogno di circa 100.000 anni (leggendo per 12 ore al giorno);

– al contrario, la visione ha una larghezza di banda molto più elevata: circa 20 MB/s. Ciascuno dei due nervi ottici ha circa 1 milione di fibre nervose, ciascuna delle quali trasporta circa 10 byte al secondo. Un bambino di 4 anni è mediamente rimasto sveglio per un totale di 16.000 ore, che si traducono in 1×10^15 byte.

C’è un’evidente disparità, che mette in evidenza per l’appunto la pregnanza del paradosso di Moravec. Dobbiamo tener presente che gran parte della conoscenza umana (e quasi tutta la conoscenza degli animali) deriva dalla nostra esperienza sensoriale del mondo fisico. La lingua e il pensiero sono la ciliegina sulla torta. Abbiamo bisogno che la torta sostenga la glassa, e non è come dirlo.

Non esiste alcuna possibilità di raggiungere un’intelligenza artificiale di livello umano senza che le macchine imparino da input sensoriali a larghezza di banda elevata, come la vista.

Mentre l’AI dipende dalla sua capacità di elaborazione di dati astratti, senza bisogno di un vero e proprio ‘corpo fisico’ a sostegno, per i robot sociali non è così, il corpo è assolutamente necessario e questo rende critico il paradosso di Moravec.

Il limite della complessità

Complexity ceiling

Ma il paradosso di Moravec non è l’unico ostacolo: un altro, forse meno evidente ma non per questo meno rilevante è il problema del limite della complessità: sappiamo tutti anche per via intuitiva che più una macchina è complessa più è suscettibile di guasti e rotture. Questo principio del senso comune è supportato da una formula precisa, denominata complexity ceiling, che in italiano può essere goffamente tradotto come ‘soffitto della complessità’ (forse meglio ‘limite della complessità’). La formula in questione è molto semplice: 2n-1. Essa significa che se un dato sistema ha un solo sottosistema, allora la possibilità di guasto sarà pari a 1 (ovviamente), se ha due sottosistemi le possibilità di guasto saranno 3, se ne ha 10 le possibilità di guasto sono 1023. La conclusione è la regola della massima semplicità possibile: dobbiamo assicurarci che il nostro robot svolga le funzioni attese con il minor numero possibile di sottosistemi. Alla fine è un altro modo per esprimere il vecchio ma sempre valido principio del rasoio di Occam: entia non sunt multiplicanda praeter necessitatem. Per i robot sociali questo ostacolo è evidentemente molto serio: più li rendiamo complessi, simili a noi e addirittura migliori, più aumentiamo la possibilità che si rompano, con tutte le conseguenze relative.

L’espressione delle emozioni

Un altro problema che forse è riduttivo definire un ostacolo, perché in realtà è molto di più, direi che è un’opzione di fondo, un’opzione filosofica, è quello relativo all’espressione delle emozioni. I robot sociali sono concepiti per avere interazioni complesse con gli esseri umani, ma questi ultimi provano emozioni, sono caratterizzati da sistemi affettivi profondi, non ultimo quello dell’empatia, e ne deriva che per avere interazioni sociali credibili con gli umani i robot devono manifestare a loro volta degli affetti, pena il ridursi a meri balocchi tecnologici, complicati quanto si vuole, ma pur sempre balocchi.

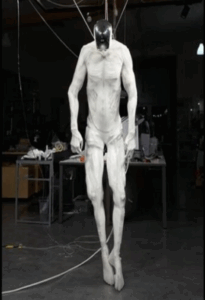

Protoclone

Ma qui si profila un’opzione progettuale importantissima: cosa vogliamo fare, vogliamo limitarci a far sì che i robot simulino le emozioni umane o che in qualche misura le provino essi stessi? Oggi, grazie al lavoro dei neuroscienziati affettivi come Antonio Damasio, Jaak Panksepp, Mark Solms e tanti altri sappiamo molte cose sui sistemi emotivi profondi (subcorticali) nel cervello umano, e non è tecnologicamente impensabile pensare di riprodurli in tutto o in parte nei robot umanoidi o androidi a venire. Può destare stupore, ma esistono già delle piattaforme tecnologiche che lavorano in questa direzione. Solo che qui si aprono degli orizzonti difficili da immaginare in tutta la loro complessità.

Basta pensare al tema del dolore. L’esperienza del dolore, da cui poi deriva l’attivazione dei sistemi emotivi ‘negativi’ della paura, della rabbia, del panico e dell’abbandono è fondativa per tutti gli animali terrestri incluso l’uomo. Ma, come s’è detto, oggi possiamo concepire delle creature artificiali che sperimentano in prima persona il dolore e le emozioni negative. Benissimo, ma vogliamo davvero farlo? E se vogliamo farlo, come vogliamo farlo?

La letteratura e il cinema ci hanno già mostrato le possibili conseguenze della creazione di androidi siffatti (Philip K. Dick, Stanley Kubrick, Ridley Scott, Steven Spielberg…), sottolineando che si tratta di situazioni-limite dal forte potenziale distruttivo. Dobbiamo capire cosa è meglio fare e dobbiamo capirlo ora.

Si tenga presente che per gli uomini il dolore non è mai soltanto un fatto bruto, ma un’esperienza che dev’essere inserita in una qualche cornice di senso che lo renda interpretabile e soprattutto tollerabile. Nel suo saggio intitolato L’esperienza del dolore. Le forme del patire nella cultura occidentale, il filosofo italiano Salvatore Natoli si è soffermato soprattutto su due di questi frame interpretativi: la tragedia greca, per la quale il dolore è una condizione ineliminabile il cui valore risiede proprio nel rivelare i limiti invalicabili del destino umano individuale e collettivo, e la prospettiva di redenzione tipica della mentalità giudaico-cristiana, secondo la quale il dolore è la porta d’accesso per una vita spirituale di ordine superiore. Senza poter qui entrare nei dettagli del pensiero di Natoli, resta da chiedersi quale frame interpretativo vorremo proporre ai poveri robot affinché anch’essi possano trovare un qualche conforto al loro soffrire.

Robotica sociale… con coscienza!

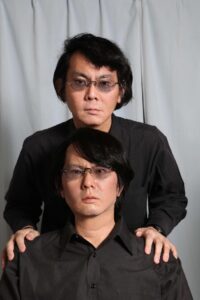

Geminoid

Abbiamo parlato di emozioni, e allora ci resta da affrontare l’ultima questione, probabilmente la più importante di tutte: è possibile una coscienza artificiale? Quando un androide sarà dotato di un sistema nervoso simile a quello umano, avrà per ciò stesso una coscienza? Farà delle esperienze soggettive oppure sarà in tutto per tutto uno zombie filosofico, che simula la vita e la coscienza senza possederli veramente?

La questione è labirintica, per molti motivi. Innanzitutto perché la coscienza resta in larga misura un mistero già per noi esseri umani. Né i filosofi (e sarebbe anche normale) né i neuroscienziati riescono a trovare uno straccio di accordo su quali siano le basi fisiologico-cognitive della coscienza né su quale sia la funzione adattativa che dovrebbe offrire un vantaggio competitivo alle creature che la possiedono. Esistono decine di teorie dai nomi altisonanti (informazione integrata, spazio di lavoro neuronale globale, ordine superiore, schema attentivo, ricorrenza locale, minimizzazione dell’energia libera, etc.) in competizione tra di loro e purtroppo tutte piuttosto difficili da falsificare.

Se questa è la situazione per quanto riguarda la coscienza negli esseri umani, figuriamoci cosa accade quando si parla di coscienza in relazione a creature artificiali!

Eppure oggi qualche solida base per cominciare a ragionare l’abbiamo. Innanzitutto, sappiamo che nell’uomo la coscienza non è un fenomeno solo corticale: per lungo tempo si è pensato che, essendo la coscienza un fenomeno complesso ed evolutivamente tardivo, essa avesse origine nella corteccia cerebrale, che è appunto la parte del sistema nervoso centrale che si è sviluppata più tardi. Parrebbe logico, ma le cose non stanno esattamente così: Jaak Panksepp ha infatti chiarito che esiste una ‘coscienza nucleare’, di base, la quale non ha affatto origine nella corteccia bensì a livello di tronco encefalico. A quanto pare, è proprio l’interazione di tre diverse strutture subcorticali, ovvero il Sistema di Attivazione Reticolare, il Grigio Periacqueduttale e il Collicolo Superiore, a ingenerare il nostro senso profondo di identità personale. Semplificando possiamo dire che mentre il Sistema Reticolare Attivante funge da motorino di avviamento e ‘modula’ i diversi stati di coscienza in cui veniamo a trovarci, il Grigio Periacqueduttale sovrintende ai nostri stati affettivi e il Collicolo Superiore monitora le dinamiche senso-motorie del corpo. La struttura nel suo insieme ci fornisce il nostro senso di identità soggettiva – quello che Panksepp ha appunto chiamato il Sé nucleare – ben prima che entrino in gioco le funzioni corticali. Se in ogni momento abbiamo coscienza di essere individui e di fare delle esperienze soggettive lo dobbiamo in primo luogo a questa struttura profonda tripartita, che peraltro condividiamo con altri animali.

Detto questo, è sicuramente vero che la cosiddetta ‘coscienza riflessiva’, quella che ci consente per l’appunto di riflettere sulle nostre esperienze come guardandole dal di fuori in una sorta di simulatore mentale, ha bisogno delle funzioni corticali per manifestarsi; in particolare ha assoluto bisogno del linguaggio o comunque di un sistema simbolico. Tuttavia è anche vero che la stessa non potrebbe manifestarsi senza il fondamentale intervento della suddetta struttura tripartita sita nel tronco encefalico.

E allora, tornando ai nostri robot sociali, una volta che questi fossero dotati di un sistema nervoso simile al nostro, manifesterebbero i segni distintivi della coscienza (nucleare o riflessiv) oppure no? A un recente seminario della Società Internazionale di Neuropsicoanalisi ho sentito Mark Solms, l’allievo più celebrato di Jaak Panksepp e autore del saggio The Hidden Source dedicato proprio al problema della coscienza, rispondere a questa domanda in senso decisamente affermativo. Perché mai un androide dotato di un sistema nervoso simile al nostro non dovrebbe possedere una coscienza? Non solo, ma Mark Solms ha anche detto di aver comunicato questa sua opinione a Thomas Nagel, autore del paper più celebre della filosofia della mente (What is it like to be a bat?), il quale gli avrebbe detto di essere assolutamente d’accordo con lui.

I grandi saggi pensano dunque che, progressi tecnologici permettendo, in futuro noi o i nostri discendenti avremo a che fare con creature artificiali consapevoli. E se questo sarà di utilità o di impiccio per la specie umana, dipende in larga parte dalle scelte che facciamo oggi.